Конфиденциальные ML-вычисления в нефтегазовой сфере

Группа компаний, состоящая из более чем 20 предприятий, занимающихся диагностикой притока и целостности всей системы нефтяных и газовых скважин, от ствола скважины до пласта, что позволяет их клиентам принимать лучшие решения и повышать эффективность активов.

Среди специализаций Заказчика: диагностика через барьер, оценка дебита скважин и пластов, оценка целостности скважин, оценка пласта в масштабах всего месторождения [многослойная, межскважинная], моделирование измерений, нефть и газ, энергетика.

Заказчик вкладывает значительную часть выручки в НИОКР, сотрудничая с университетами и партнёрами для развития диагностики. Они разрабатывают программы, собирают данные, создают инструменты и ПО, интерпретируют данные, что делает их лидером в диагностике через барьеры.

Нефтяные компании тщательно защищают свои данные. Доступ к ним строго контролируется как между конкурентами, так и внутри компании, между разными отделами. Сохранение конфиденциальности таких данных является приоритетом, особенно когда законодательство запрещает вывоз данных за границу.

С другой стороны, компании активно развивают предиктивную диагностику скважин с использованием методов искусственного интеллекта. Явным препятствием на пути развития ML-алгоритмов является нежелание или неспособность владельцев данных делиться своими данными с ML-разработчиками из-за потенциальных угроз, таких как утечки, кражи и незаконное использование.

В данном случае речь идёт об обнаружении песка на объектах добычи и хранения нефти и газа.

В процессе добычи и хранения газа, газового конденсата и нефти операторы по всему миру сталкиваются с проблемой выноса песка из скважин.

Вынос песка вызывает поломки оборудования, снижает эффективность скважин и увеличивает затраты на эксплуатацию.

Эта проблема остро стоит в нефтегазовой отрасли, как на добывающих скважинах, так и в подземных хранилищах нефти и газа.

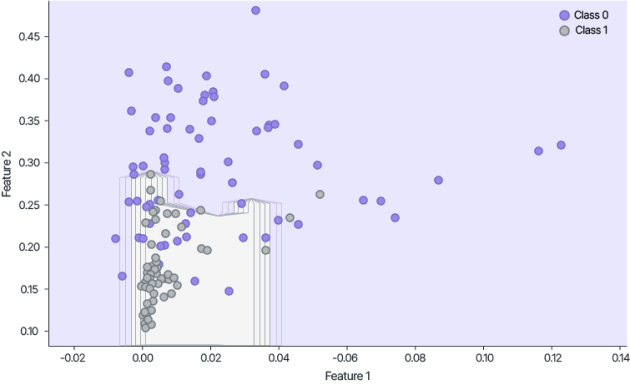

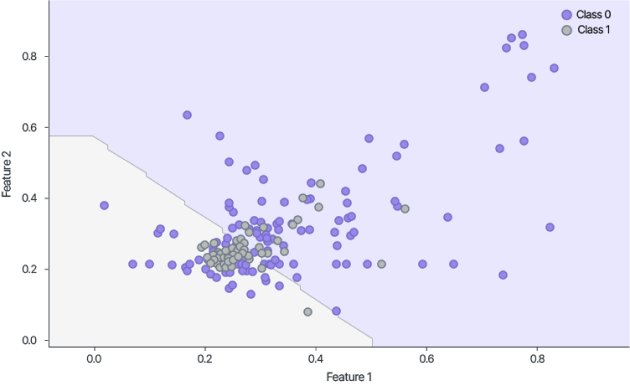

Для соблюдения конфиденциальности и обучения моделей данные от разных организаций обменивались в зашифрованном виде.

Защита данных была обеспечена на всех этапах, включая обучение и вывод результатов.

Guardora обеспечила полное обучение ML-модели на зашифрованных данных с последующим выводом на зашифрованных образцах.

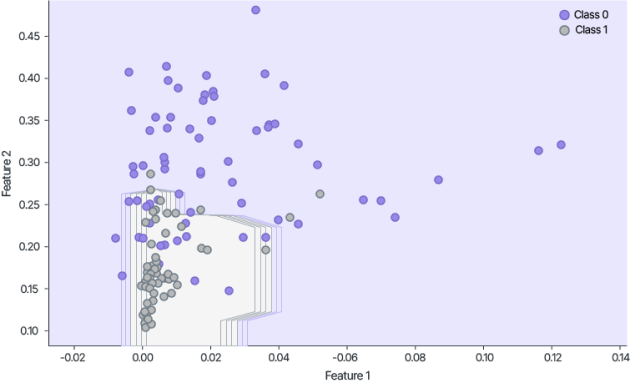

Если модель расшифрована, её можно применять на открытых данных с аналогичными характеристиками. Это удобно, когда обучение происходит в облаке, а затем модель используется на своих ресурсах или открытых данных.

Guardora также обучила модель на открытых данных, а затем адаптировала её для вывода зашифрованных образцов.

Обучающая выборка не содержала секретных данных, но последующая обработка касалась конфиденциальной информации.